从安装到使用:DeepSeek 本地部署与模型性能测试(英伟达4060显卡)

编辑前言

DeepSeek近来非常火爆,过年期间我一直都在密切关注相关动态。经过多次使用后,确实感受到这个工具的强大功能,但随着热度攀升,网络攻击增多导致使用体验有所下降,再加上官方API目前处于不可用状态,因此我萌生了本地部署的想法。根据了解到的配置信息,DeepSeek提供了不同大小的模型版本:1.5b到70b均为基于r1核心模型开发的蒸馏版本;而完整版的r1模型则高达671亿参数量,对硬件配置要求极高,对于家庭用户和个人玩家来说,完整版本部署成本太高,本期我将结合我手中现有的配置来部署基于R1的蒸馏小模型,看看体验怎么样。

机器配置

本次部署的配置如下:

软件框架选择

目前常用的本地 AI 模型部署方式主要有以下两种,两者部署都需要一个良好的上网环境,本期教程我们使用Ollama,因为下载模型比较方便,LM Studio涉及到更换源,对于初次接触的新手可能会有些难度。

1. Ollama

-

简介:Ollama 是一个轻量级的本地 AI 推理框架,支持一键下载和运行各种大模型,如 Llama、Mistral 等。

-

特点:

-

开箱即用,适用于 macOS 和 Linux

-

提供 CLI 方式调用,支持 API 集成。

-

资源占用相对较低,适合个人用户在本地部署 AI 模型。

-

-

适用场景:本地聊天助手、代码生成、文本处理等轻量级 AI 任务。

2. LM Studio

-

简介:LM Studio 是一款 GUI 界面的本地 AI 模型管理工具,简化了 AI 模型的下载、管理和运行。

-

特点:

-

提供用户友好的图形界面,适合不熟悉命令行的用户。

-

支持 GGUF 格式的 LLM 模型,并兼容许多开源模型。

-

允许本地 API 访问,方便与其他应用集成。

-

-

适用场景:适合需要可视化界面、低代码环境的用户,如本地 AI 助手、编程辅助、知识问答等。

这两种方式各有优势,Ollama 更适合开发者和轻量级 API 集成,而 LM Studio 则更适合普通用户和 GUI 交互需求。

ollama安装

1、搜索ollama,进入官网,根据系统下载对应的安装包,然后进行安装,过程较为简单,不做演示。

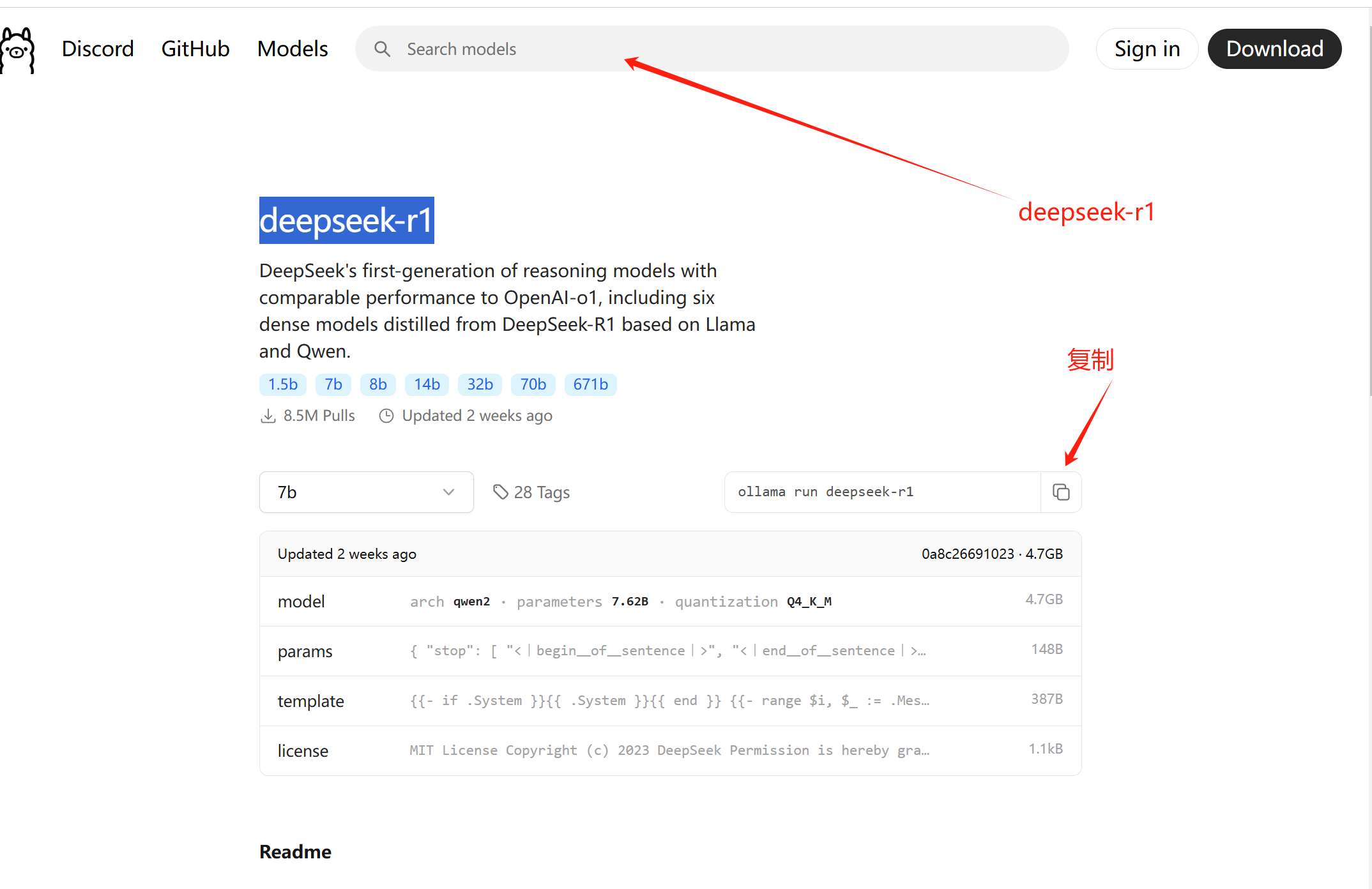

2、再次打开ollama官网,在搜索框输入deepseek,点击搜索,根本配置表格选择模型参数,这里我选择的是默认的7B模型,点击复制按钮。

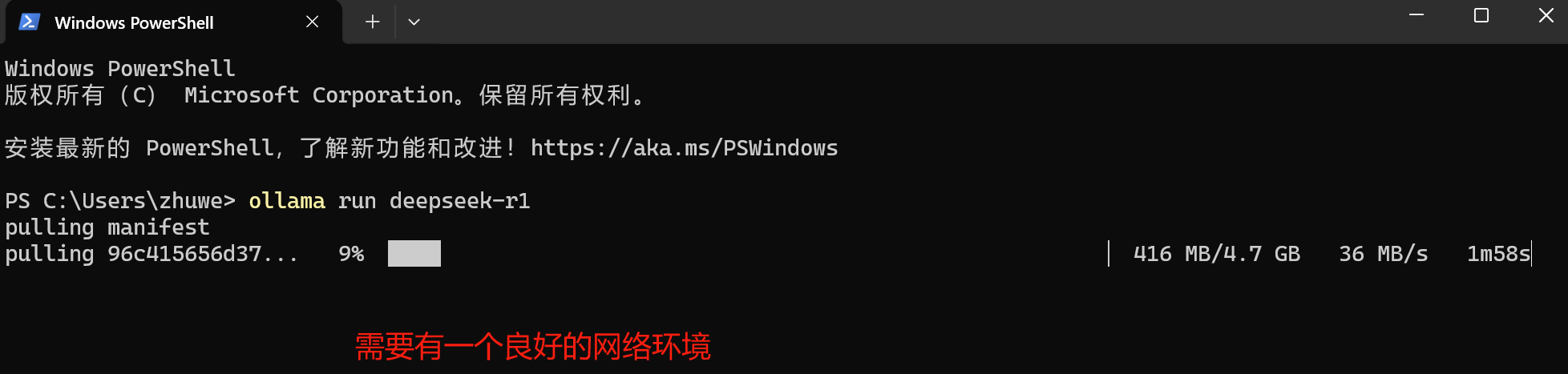

3、打开终端,粘贴命令,模型会自动下载,完成部署。

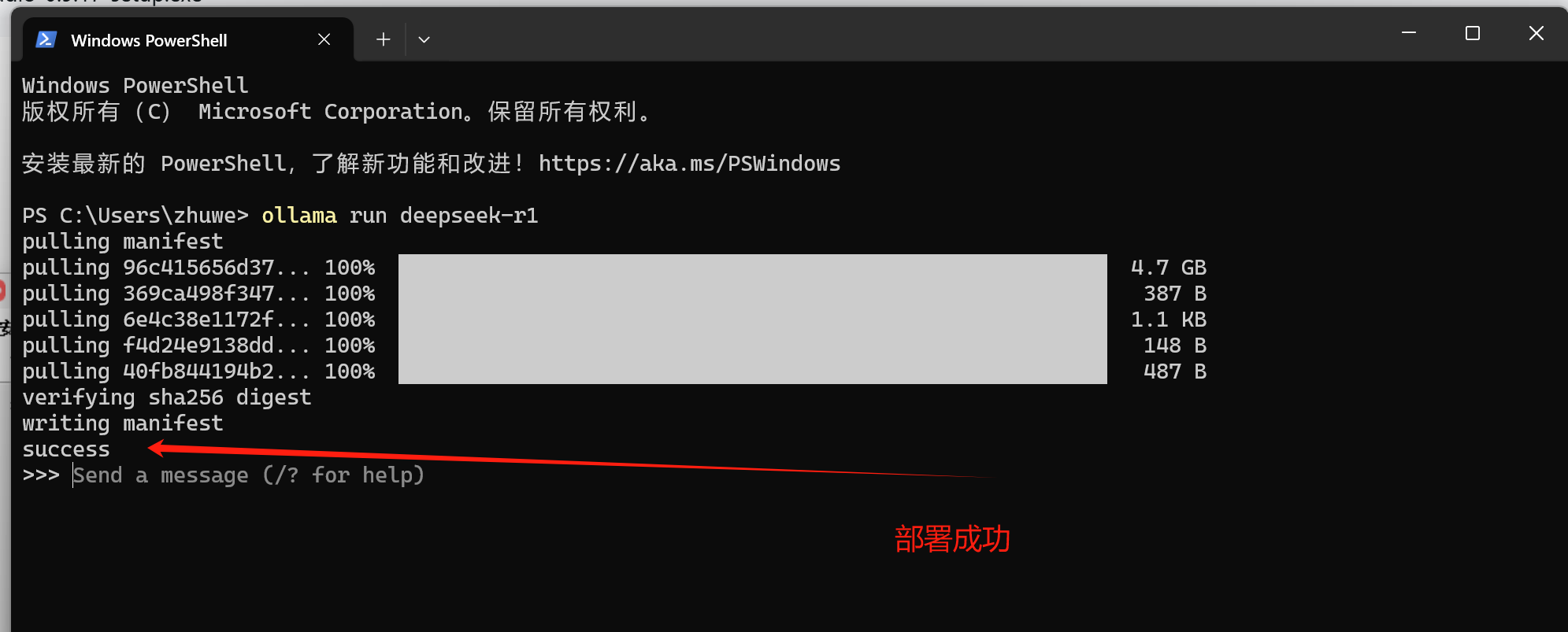

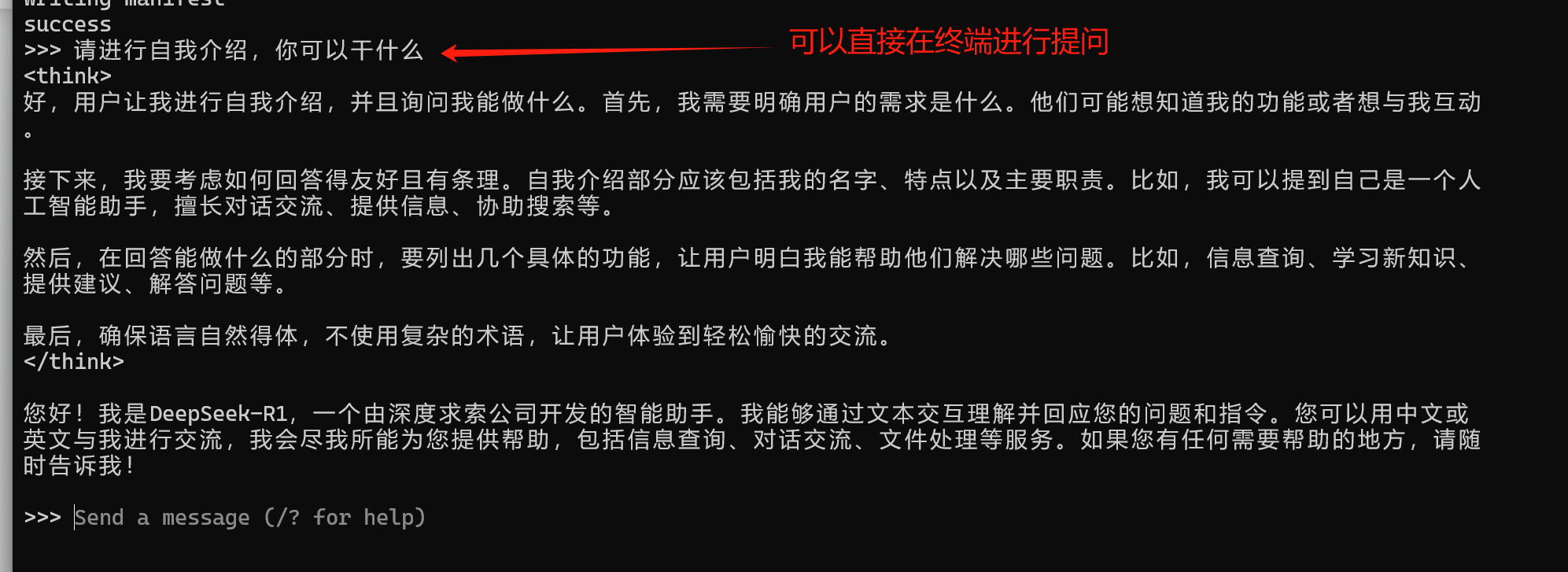

4、出现如下提示,表示已经部署成功,

5、接下来就可以直接使用终端进行对话。

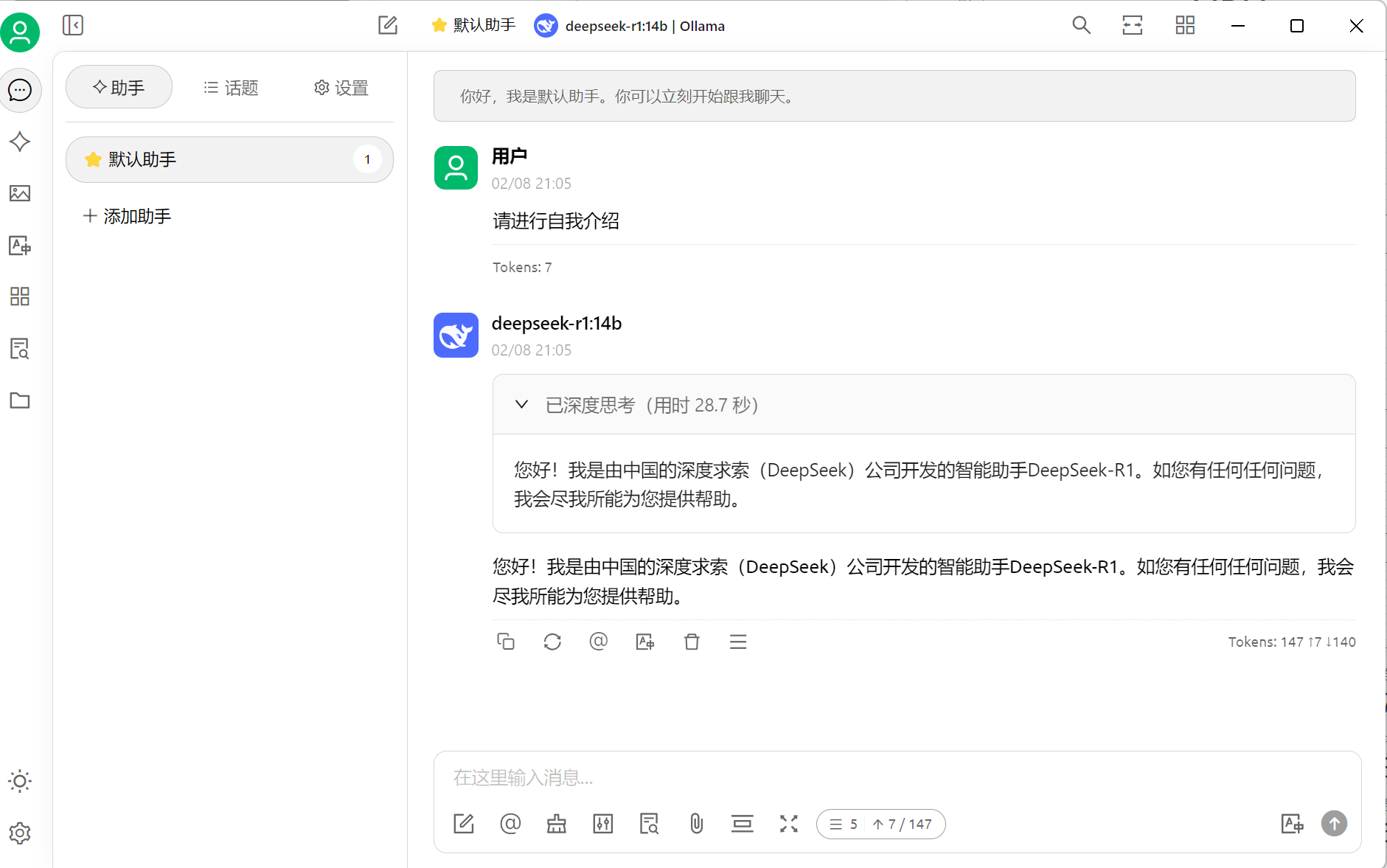

Cherry-Studio安装

1、ollama默认的终端交互页面很简陋,我们可以通过第三方软件来提高交互体验,这里使用的是Cherry-Studio,安装方式非常简单,直接在官方下载对应系统的安装包即可,安装过程全程下一步即可。

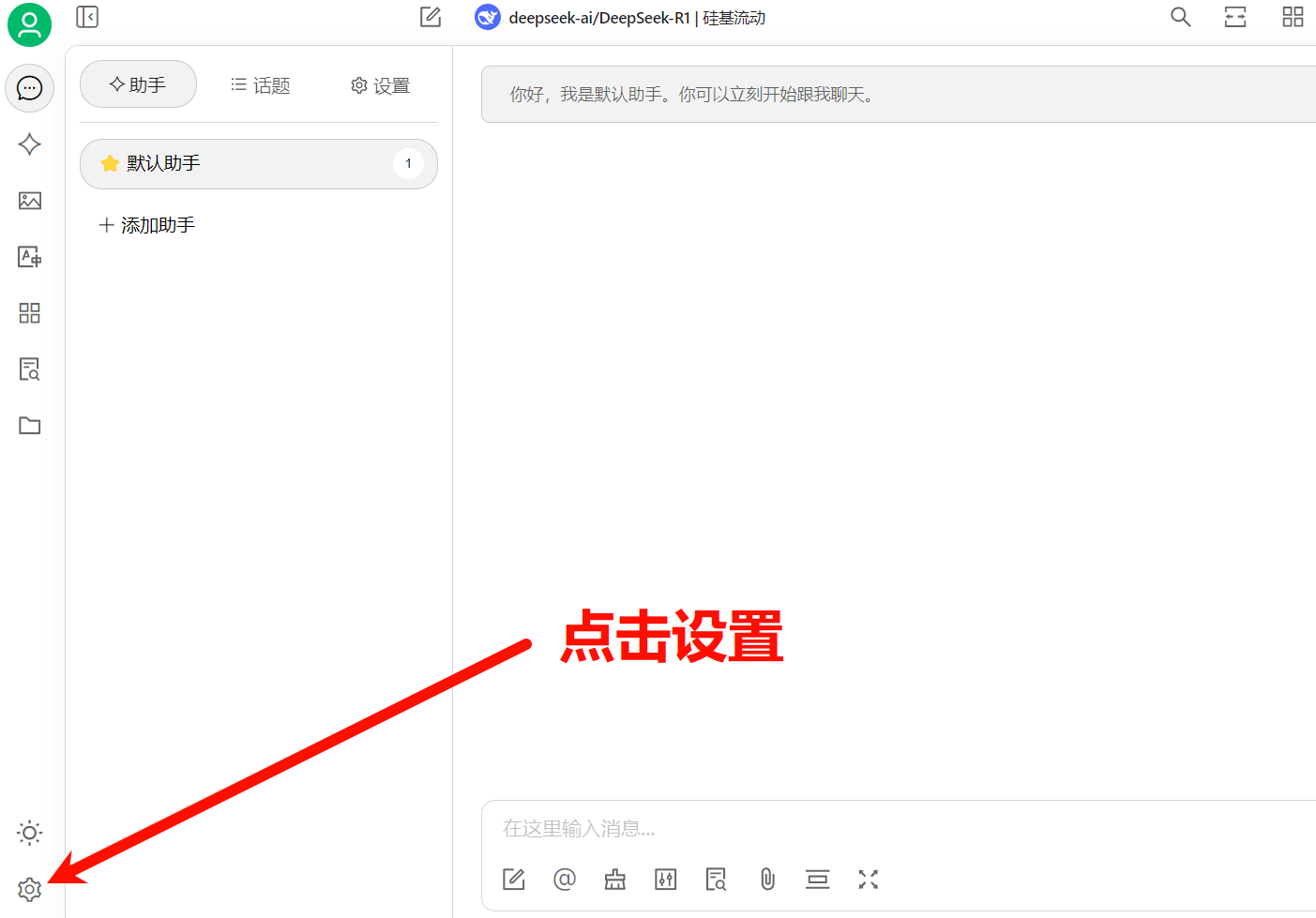

2、软件安装完成后打开软件,出现如下页面,接下来我们进行简单的配置,将ollama集成到Cherry-Studio中,点击左下角的设置。

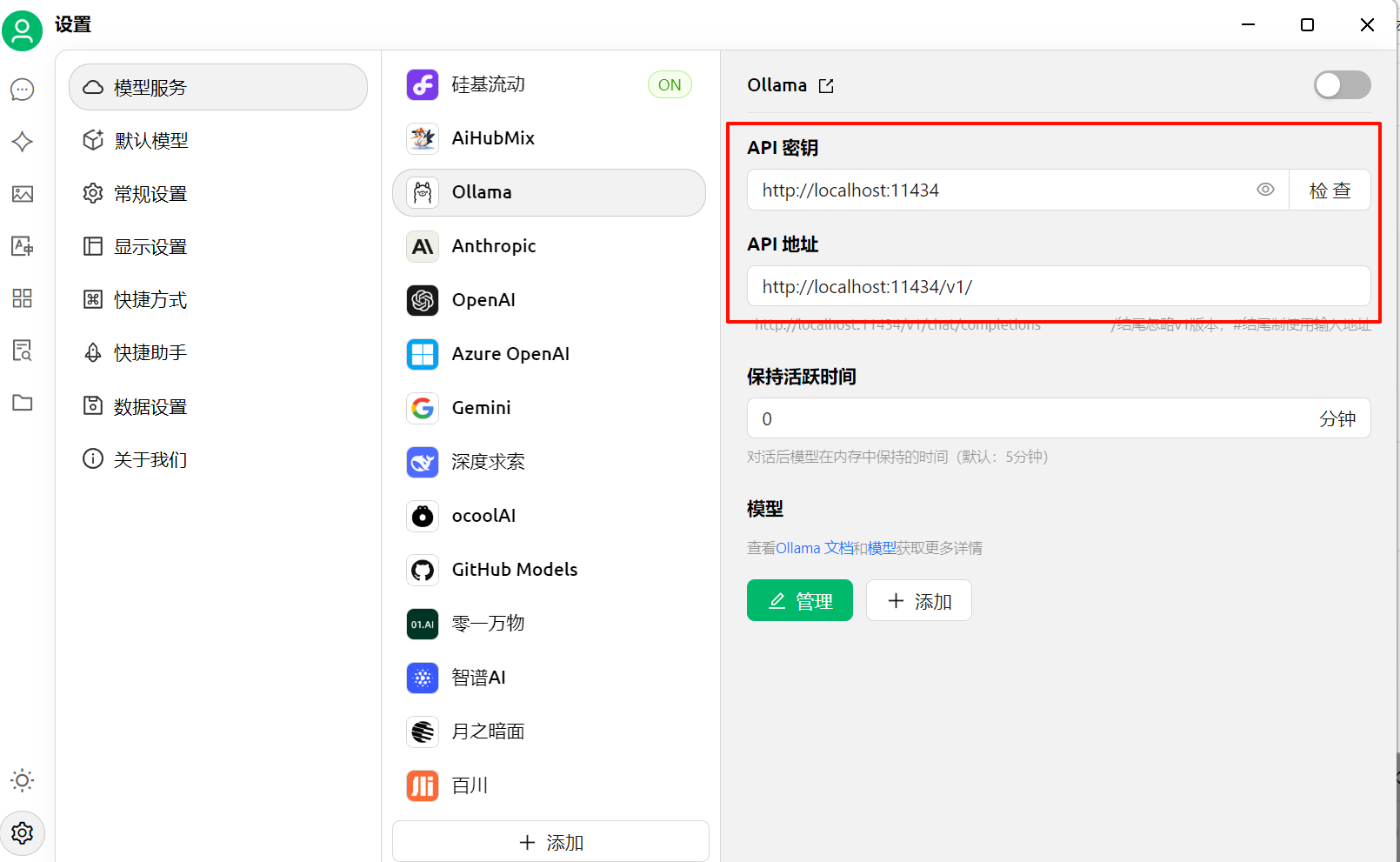

3、点击模型服务,找到ollama,这里需要注意ollama和cherry studio安装在同一台机器上,所以api地址填写 http://localhost:11424/v1/(默认已经填写好了,如果部署在局域网其他机器,请更改location为ip地址,其他保持默认即可)

4、接下来添加模型,点击管理,会自动弹出ollama已经安装的模型,点击模型后面的+号即可。

5、模型会自动启用,然后回到聊天页面即可使用AI模型,通过点击顶部的模型选项,可以切换到其他模型。

6、Cherry-Studio软件添加模型和使用还是比较简单的,都有对应的中文说明,自信研究即可,不做过多介绍。

不同参数模型速度

下面为不同参数模型在4060显卡上的输出速度。

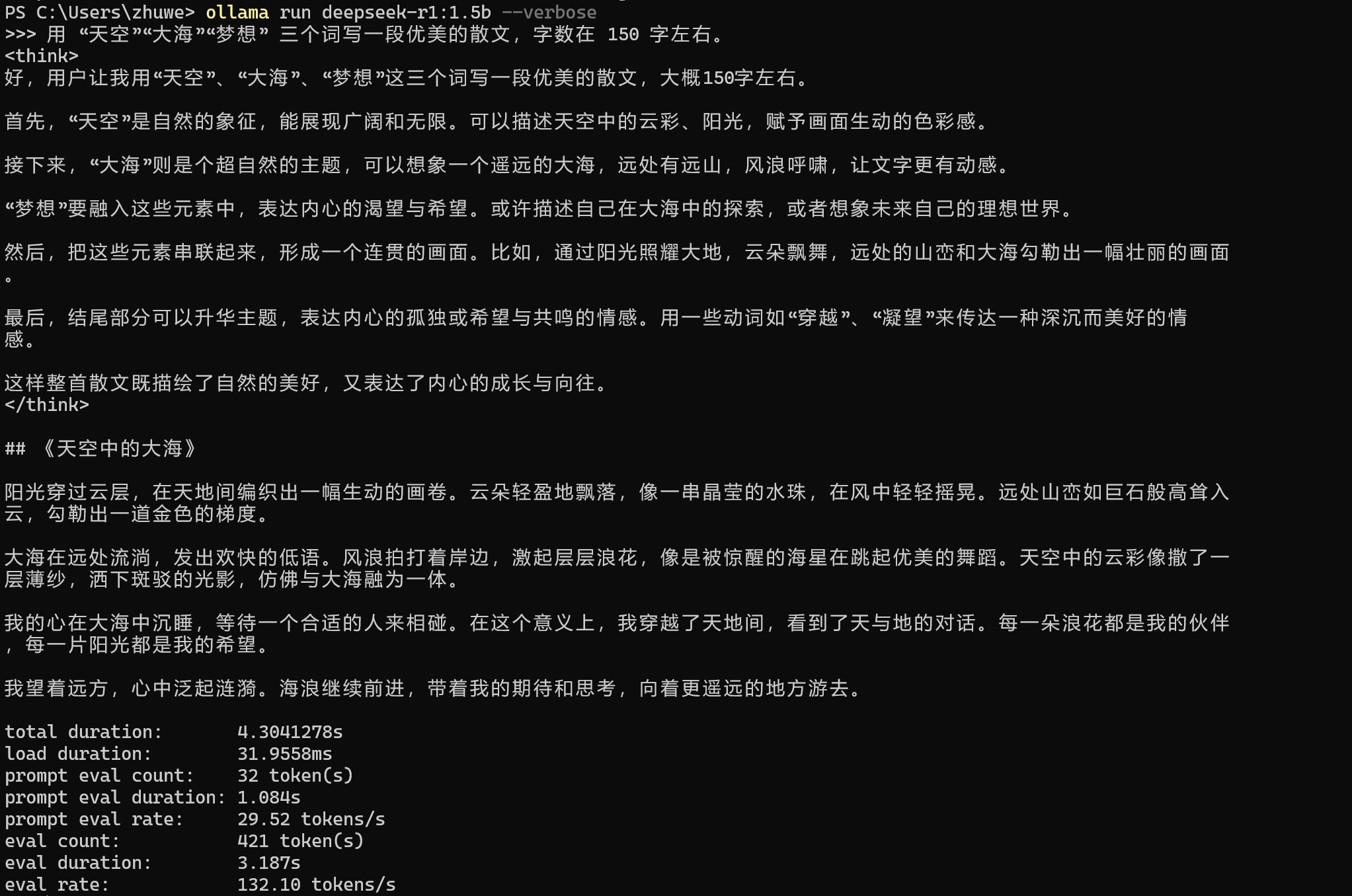

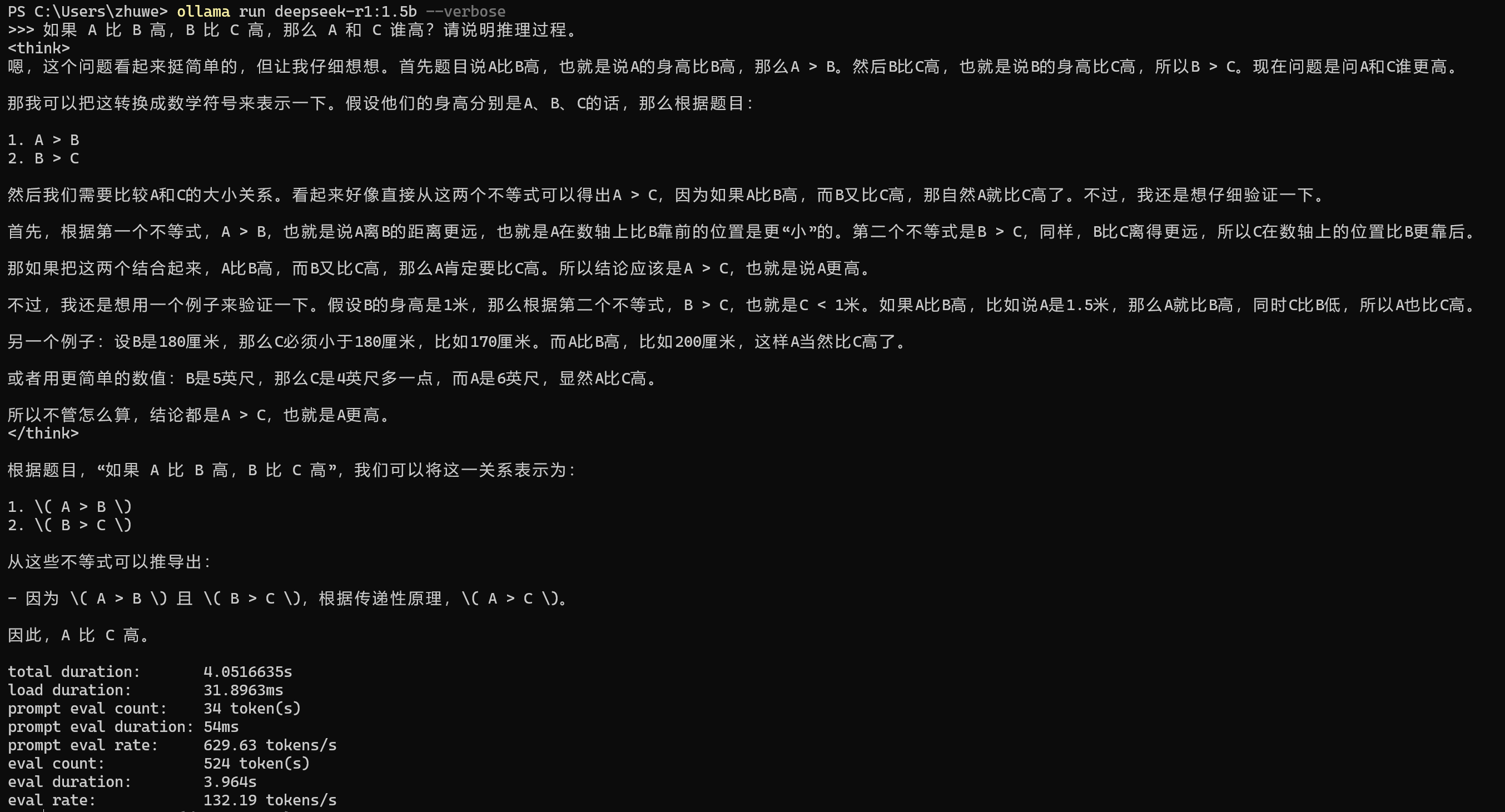

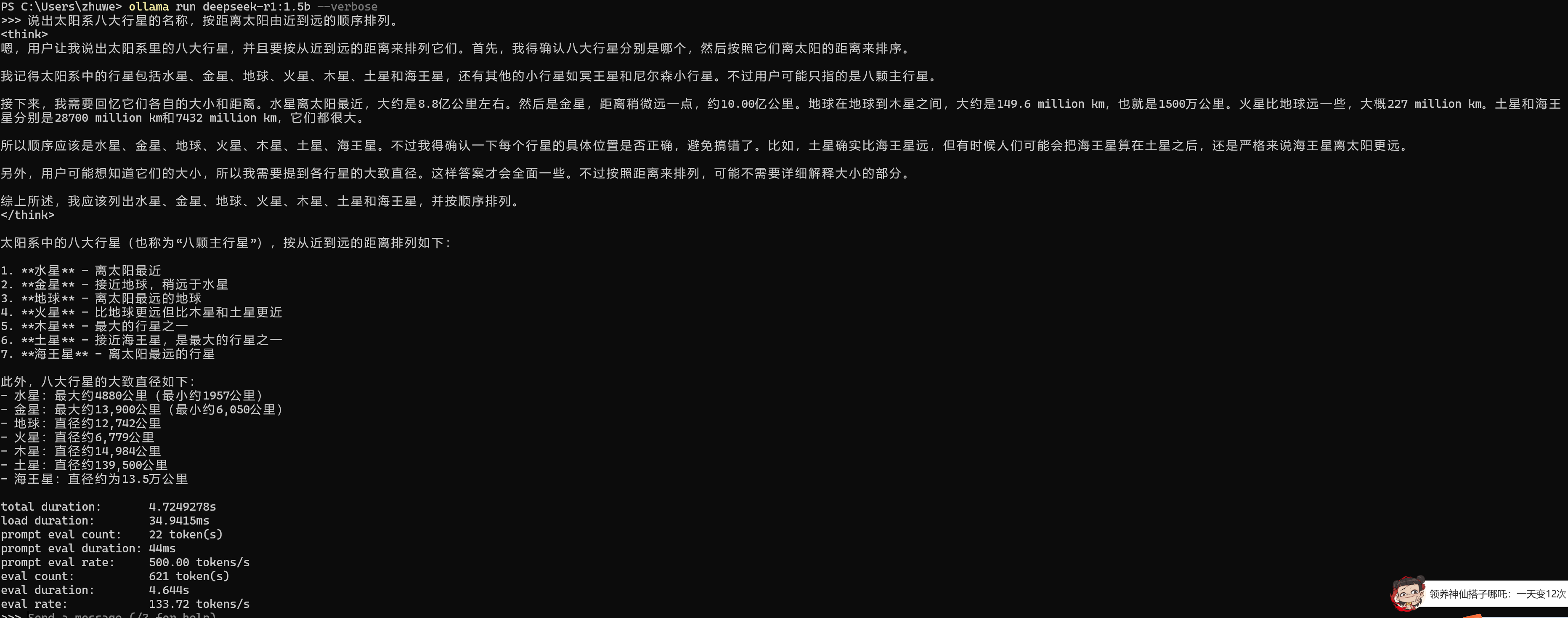

1.5b

Q1:用 “天空”“大海”“梦想” 三个词写一段优美的散文,字数在 150 字左右。

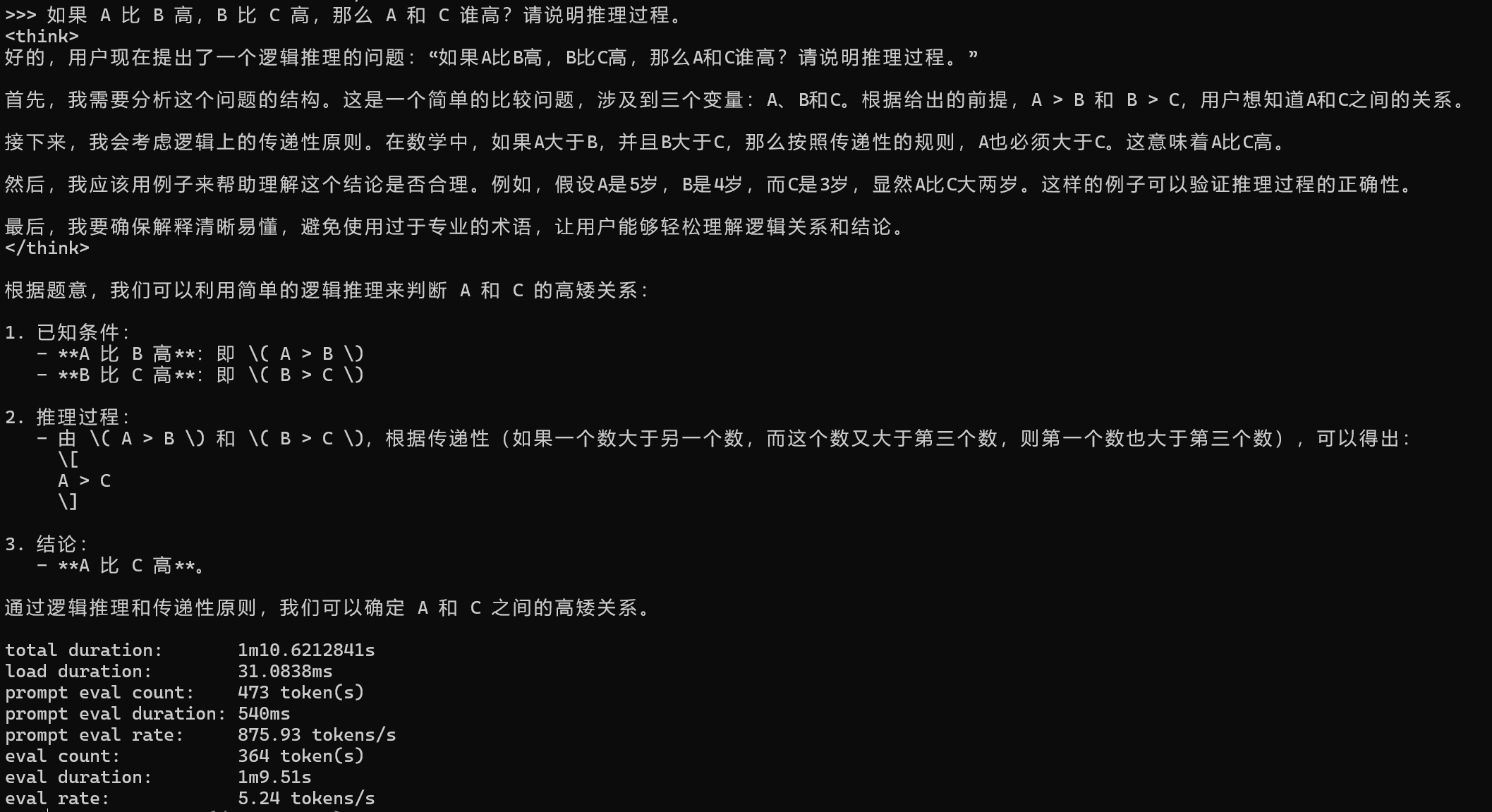

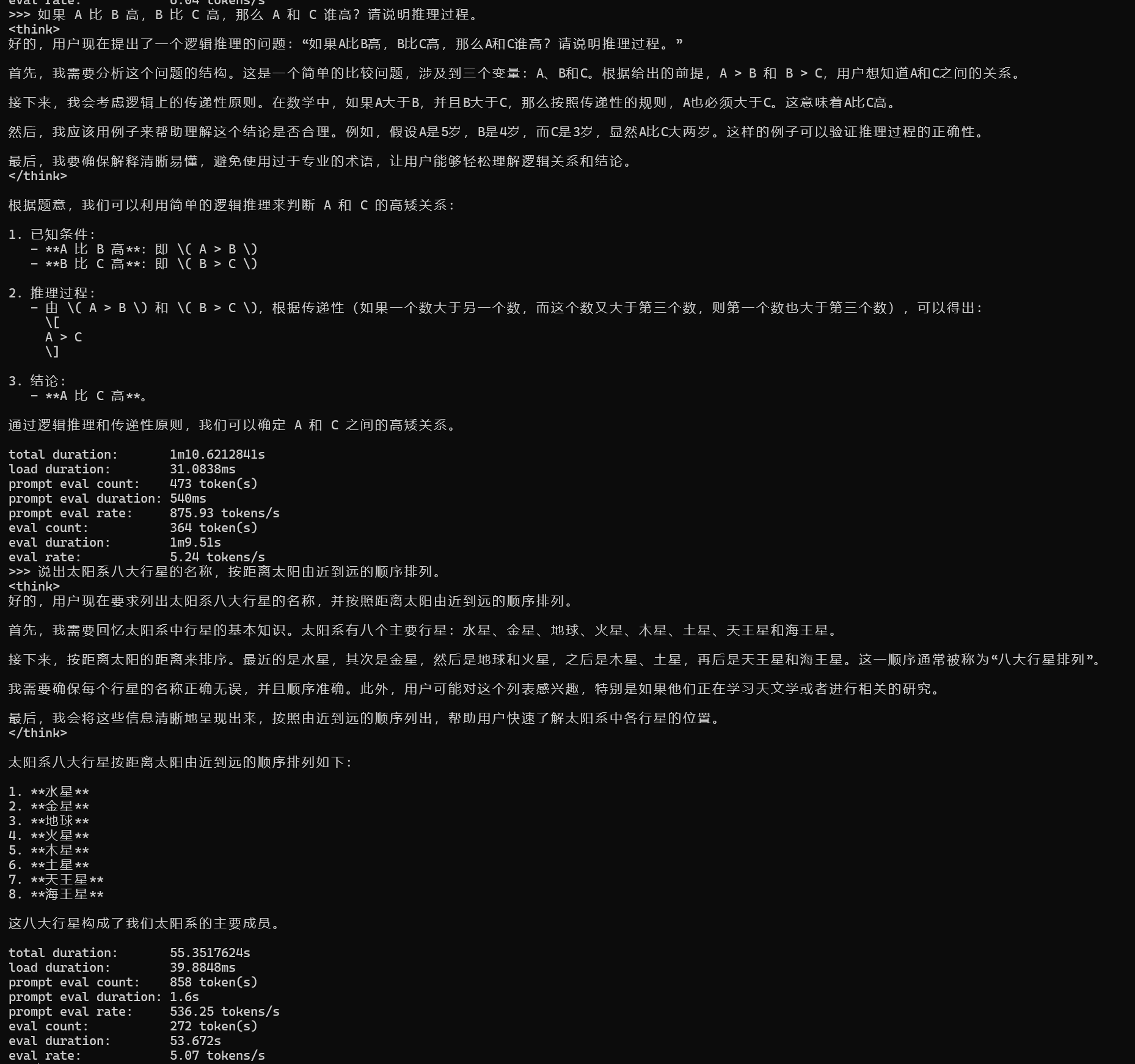

Q2: 如果 A 比 B 高,B 比 C 高,那么 A 和 C 谁高?请说明推理过程。

Q3:说出太阳系八大行星的名称,按距离太阳由近到远的顺序排列。

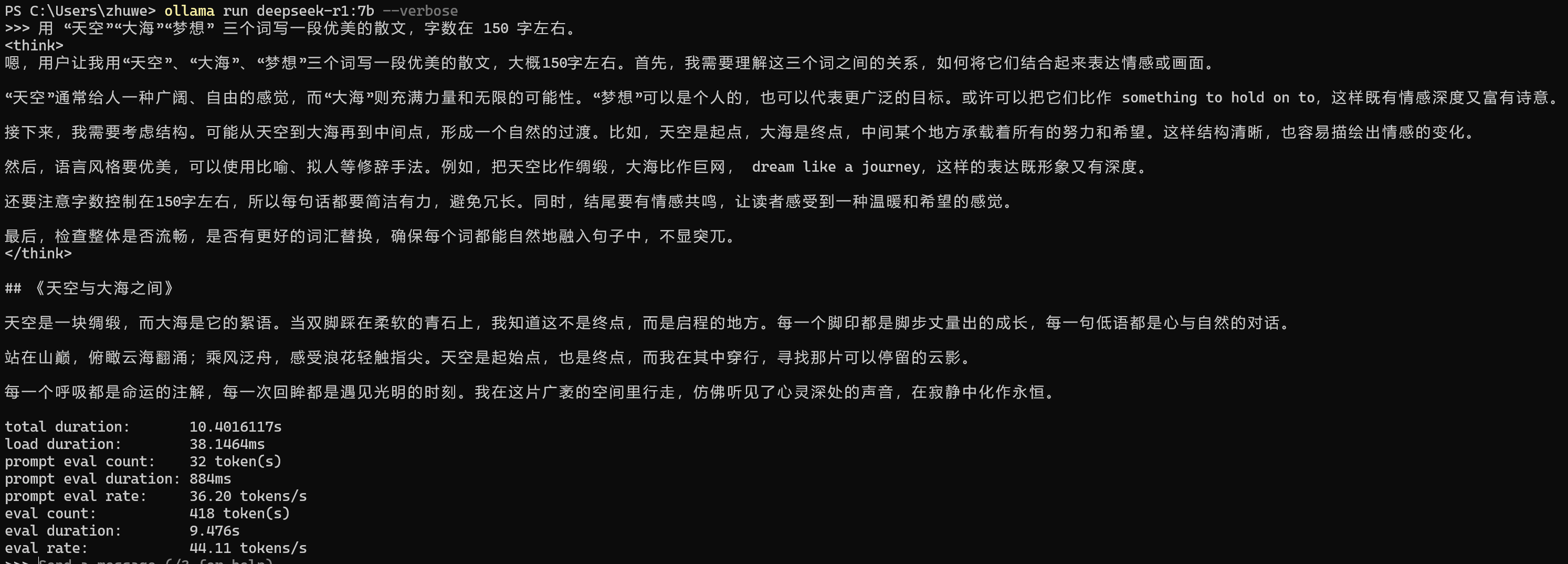

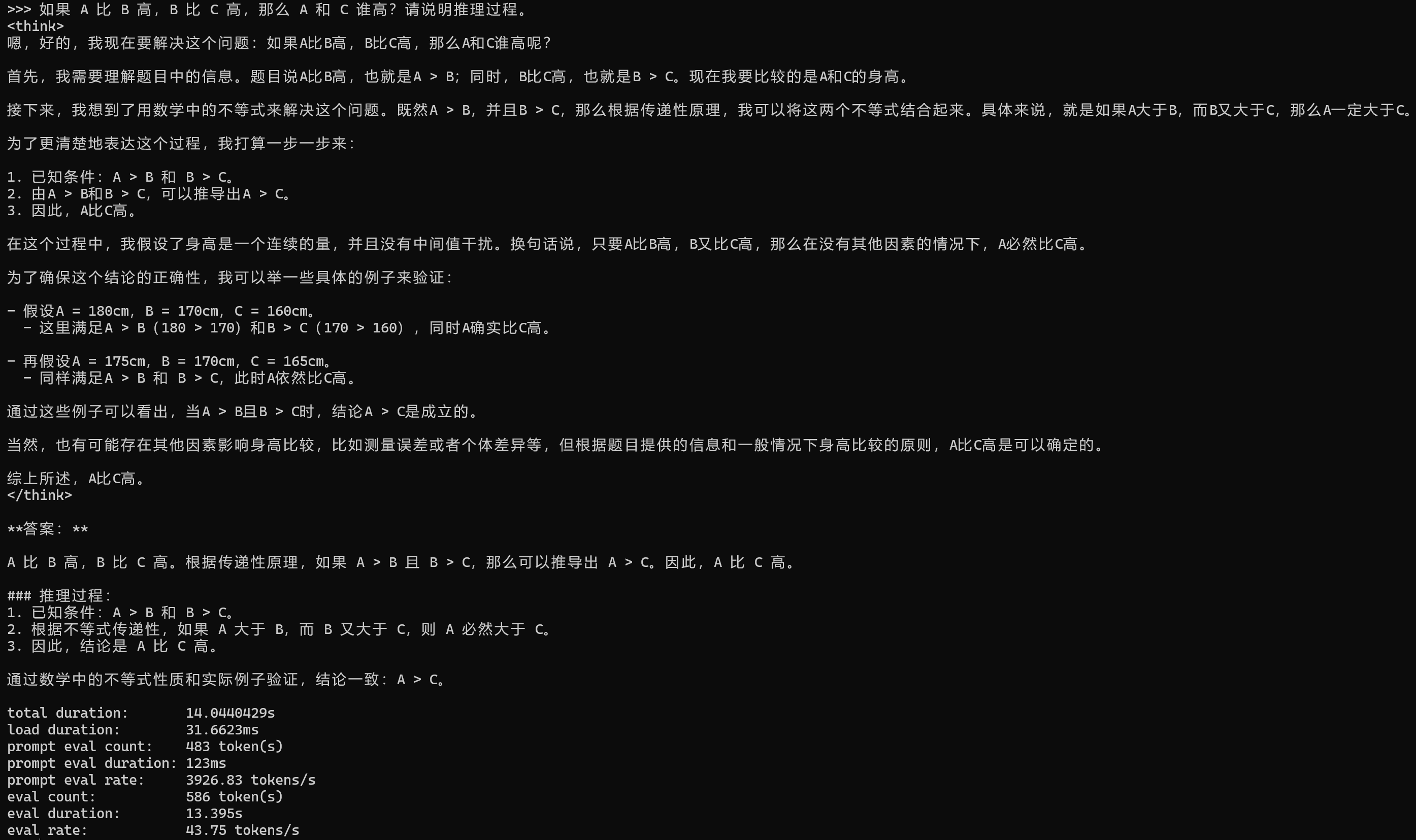

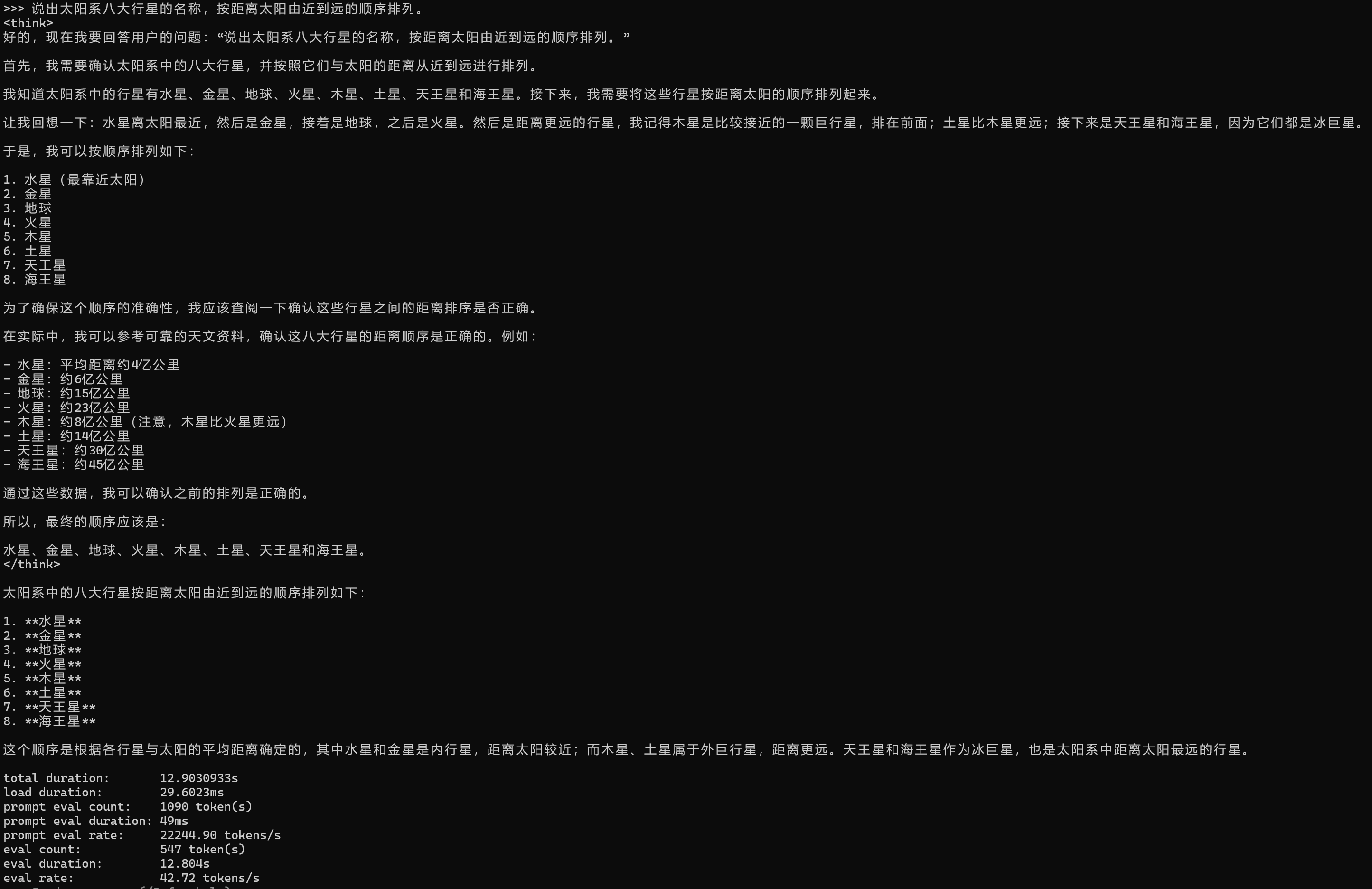

7b

Q1:用 “天空”“大海”“梦想” 三个词写一段优美的散文,字数在 150 字左右。

Q2: 如果 A 比 B 高,B 比 C 高,那么 A 和 C 谁高?请说明推理过程。

Q3:说出太阳系八大行星的名称,按距离太阳由近到远的顺序排列。

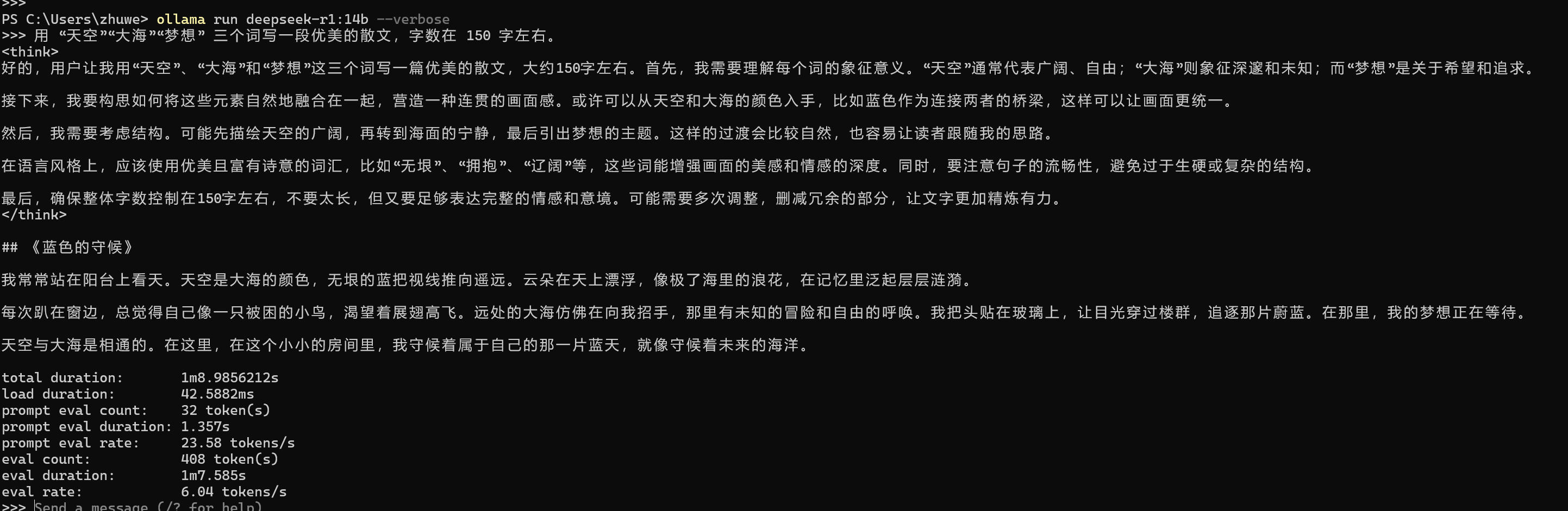

14B

Q1:用 “天空”“大海”“梦想” 三个词写一段优美的散文,字数在 150 字左右。

Q2: 如果 A 比 B 高,B 比 C 高,那么 A 和 C 谁高?请说明推理过程。

Q3:说出太阳系八大行星的名称,按距离太阳由近到远的顺序排列。

完整R1

本来想上一个完整R1模型的回答效果的,结果无论是尝试了硅基流动和官方的API都提示提示服务器错误,这里就不在贴图了。

总结

相对于完整版本的r1回答差距太大,72b的模型个人还是可以玩玩的,72以下更多是个玩具,很多语言逻辑bug,接下来我尝试使用AMD的8600g+64G ddr5内存部署个32b看看。

- 2

- 0

-

分享